【新手也能读懂的超详细论文解读】Show and Tell: A Neural Image Caption Generator |

您所在的位置:网站首页 › show and tell教学设计 › 【新手也能读懂的超详细论文解读】Show and Tell: A Neural Image Caption Generator |

【新手也能读懂的超详细论文解读】Show and Tell: A Neural Image Caption Generator

|

Show and Tell: A Neural Image Caption Generator

前言(与论文无关)简介模型总结

前言(与论文无关)

最近事情比较多,除了考试还有导师布置的任务,还有几门考试,当然还要花时间打游戏,所以呢没有时间每天都更新。不过我还是希望不要颓废,这个定时看论文写笔记的习惯要好好保持。那就决定以后每周会固定更新两篇,空闲时间多的话会再多写。封锁在学校里最大的影响就是没法练琴了,啊啊啊啊好想谈琴啊!!! 简介这同样是cvpr 2015的一篇文章,也是师姐叮嘱专门读的一篇。这篇读完可以算是对图像描述这个方向有个大体的了解,里面所使用的编码-解码的结构甚至到现在都是很实用的,后来的大多数这方面的文章都是在该模型的基础上进行的优化改良。 文章开篇就讲,这篇论文将最近比较火的计算机视觉和机器翻译两个领域融合起来,从而有了这个模型。图像描述比目标检测和图像分类更加难一点,因为好的描述不仅仅要抓住图像中的客观物体,更要表述出这些目标之间的关系。不仅如此,还得考虑语义,不同的语言还得考虑语法。 那个时候现有的办法都是讲解决上述每个子问题的方法合在一起来生成图像描述,而这篇论文则首次提出用一个模型来解决所有的问题,俗称一步到胃(狗头)。 这篇论文的几个创新点(原文): First, we present an end-to-end system for the problem. It is a neural net which is fully trainable using stochastic gradient descent. 提出了一个 Neural Image Caption(NIC)模型来生成图像描述,该模型的优化目标可以使用梯度下降来训练。 Second, our model combines state-of-art sub-networks for vision and language models. These can be pre-trained on larger corpora and thus can take advantage of additional data. 该模型结合了现有的一些用于视觉和语言模型的最新子网,所以可以保证有足够的数据来进行预训练。 Finally, it yields significantly better performance compared to state-of-the-art approaches. 最后呢,当然是每篇论文都有的话,只不过这篇说的更拽一点:我们的模型优于现有的所有模型。 模型这个模型的意思呢就是参考机器翻译那样,把图像编码成一种可以用来表示主要特征的机器语言,然后再讲该语言像中英文翻译的那种方法来“翻译”出来,从而形成图像描述。我们可以通过以下公式最大化生成单词的概率: 我想这个在前面介绍里面已经或多或少的提到过了。函数f是解码环节的LSTM模型,而Xt的形成则是编码环节的CNN。而整体的模型是这个亚子的: 这篇文章提出了一个可以自动查看图像并以简单的英语生成合理描述的端到端神经网络系统,称之为NIC。这个模型在后面读其他图像描述模型时会经常出现。NIC由一个CNN来对图像进行编码,以及LSTM进行解码的模型。该模型的优化目标为最大化给定图像产生句子的似然。从这些实验中可以清楚地看出,随着可用的图像描述数据集的大小增加,NIC等方法的性能也会提高。 此外,有趣的是,人们将如何使用无监督数据(无论是单独的图像还是单独的文本)来改善图像描述方法。 |

【本文地址】

今日新闻 |

点击排行 |

|

推荐新闻 |

图片新闻 |

|

专题文章 |

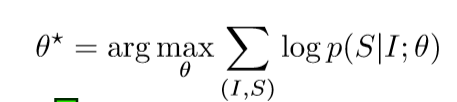

其中cita是模型的参数,I代表输入图像,S是图像的正确描述。由于S的长度是不固定的,所以我们需要用链式法则来求联合概率分布,公式则变为:

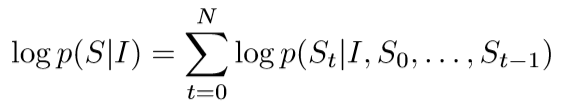

其中cita是模型的参数,I代表输入图像,S是图像的正确描述。由于S的长度是不固定的,所以我们需要用链式法则来求联合概率分布,公式则变为:  在训练时,(S,I)是一组训练数据,同时在训练过程中使用随机梯度下降对第二个公式进行优化。自然而然地我们可以用RNN为概率p(St|I,S0,…,St−1) 进行建模,其中不同地单词用固定长度的隐藏状态或者记忆ht来表示。其中ht是在收到一个输入Xt之后通过一个非线性函数变换得到:

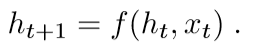

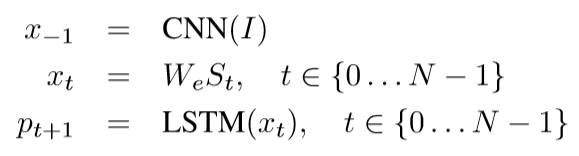

在训练时,(S,I)是一组训练数据,同时在训练过程中使用随机梯度下降对第二个公式进行优化。自然而然地我们可以用RNN为概率p(St|I,S0,…,St−1) 进行建模,其中不同地单词用固定长度的隐藏状态或者记忆ht来表示。其中ht是在收到一个输入Xt之后通过一个非线性函数变换得到:  要是的这个RNN更加具体我们需要关注这两个问题:函数f的具体形式是什么?图像和单词是如何变为输入Xt的?

要是的这个RNN更加具体我们需要关注这两个问题:函数f的具体形式是什么?图像和单词是如何变为输入Xt的? 值得一提的是LSTM在第t-1时间步产生的输出St-1会再带入到第t时间步中去,这其实算是LSTM的一个特性吧。文章中还花了大篇幅讲解LSTM模型的原理,这里我就不多赘述。总之,模型展开是这样的:

值得一提的是LSTM在第t-1时间步产生的输出St-1会再带入到第t时间步中去,这其实算是LSTM的一个特性吧。文章中还花了大篇幅讲解LSTM模型的原理,这里我就不多赘述。总之,模型展开是这样的:  我们的损失是每一步正确单词的负对数似然之和,如下所示:

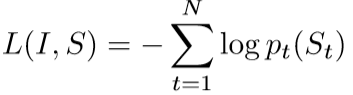

我们的损失是每一步正确单词的负对数似然之和,如下所示: